《融合环境特征与改进YOLOv4的安全帽佩戴检测方法》

发表于《中国图象图形学报》

荣获该学报2022年度优秀论文

摘要

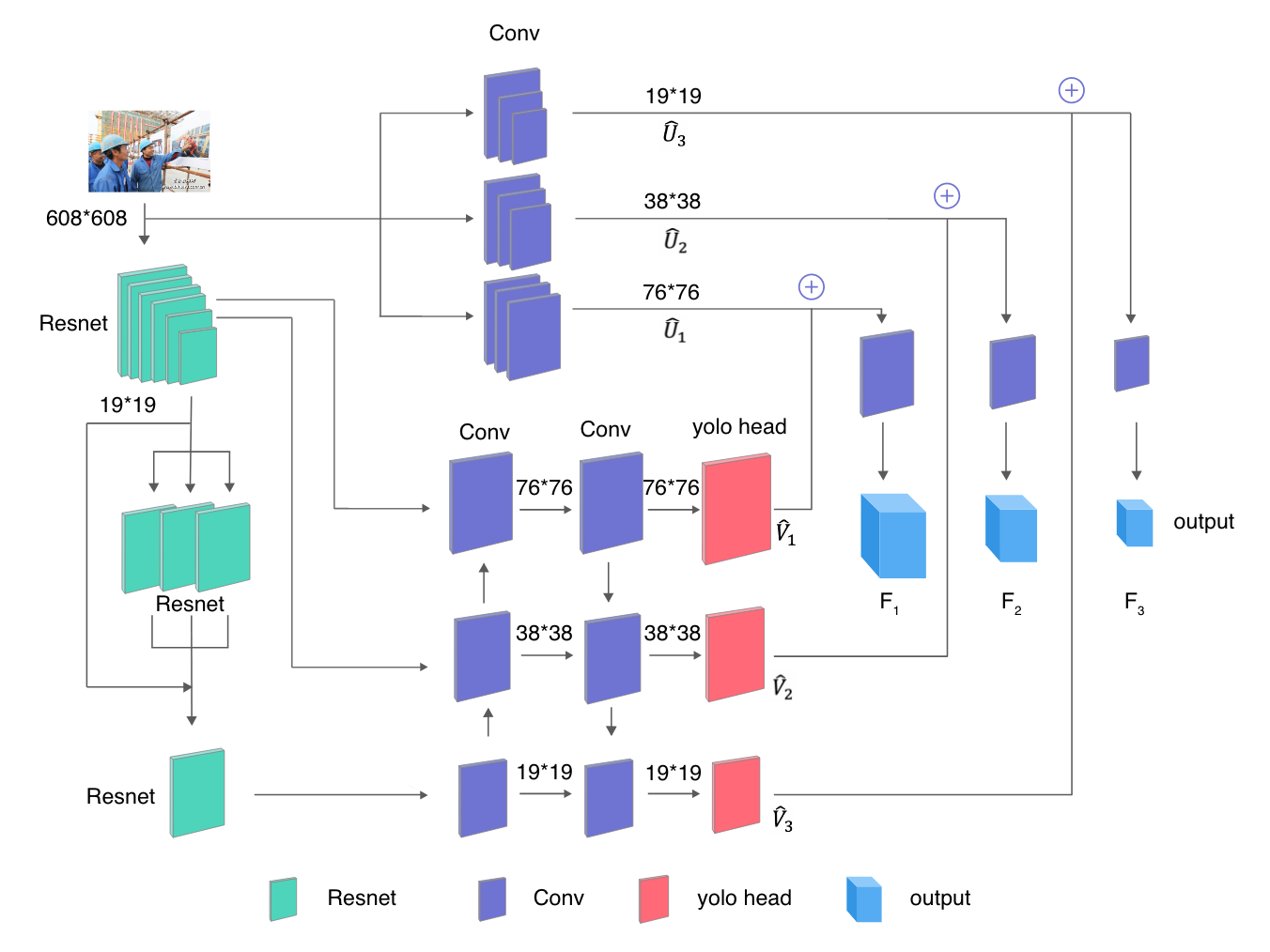

目的 在施工现场,安全帽是最为常见和实用的个人防护用具,能够有效防止和减轻意外带来的头部伤害。但在施工现场的安全帽佩戴检测任务中,经常出现难以检测到小目标,或因为复杂多变的环境因素导致检测准确率降低等情况。针对这些问题,提出了一种融合环境特征与改进YOLOv4的安全帽佩戴检测方法以实现高效检测。方法 为补充丢失的特征,在保证感受野一致的情况下,将YOLOv4得到的三种不同大小的输出特征图与原图经过特征提取得到的特征图相加,从而将高层特征与低层特征融合,捕捉更多细节信息;对融合后的特征图采用3 x 3的卷积操作,以减小特征图融合后的混叠效应,保证特征稳定性,使得模型在大小目标检测上均能达到更高的准确率;同时,为适应施工现场的各种环境,采用多种数据增强方式进行环境模拟,并采用对抗训练方法增强模型的泛化能力和鲁棒性。结果 本文提出的改进YOLOv4方法在开源安全帽佩戴检测数据集(Safety Helmet Wearing Dataset, SHWD)上进行测试,mAP(Mean Average Precision)达到91.55%,recall达到98.62%。将该方法与CornerNet-Lite,Faster RCNN,YOLOv3,YOLOv4等安全帽佩戴检测算法进行对比,结果显示本文方法在mAP和recall上均有较大提升,其中相较于现有的YOLOv4算法,mAP和recall分别提高了5.2%和5.79%。并且,融合环境特征进行数据增强后,上述五种方法的mAP均有提高,提高2%~5%不等,其中本文提出的改进YOLOv4方法提高了4.27%,达到95.82%。此外,相较于数据增强前,改进YOLOv4在数据增强后的各种真实环境条件下进行测试时,都有较稳定的表现,检测准确率依然能保持在较高水平,其中对夜晚图片的检测效果提升尤其明显,mAP从67.73%提升至84.10%。结论 本文所提出的融合环境特征与改进YOLOv4的安全帽佩戴检测方法,以改进模型和数据增强的方式提升模型准确率、泛化能力和鲁棒性,为安全帽佩戴检测提供了有效保障。

模型结构图